릴리스 노트

제품 공지

jar 파일 이름 | 설명 | 다운로드 주소 |

cos-distcp-1.12-3.1.0.jar | COSN에 데이터를 복사할 COSDistCp 패키지 | COSDistCp 툴을 참고하십시오 |

chdfs_hadoop_plugin_network-2.8.jar | OFS 플러그인 |

jar 파일 이름 | 설명 | 다운로드 주소 |

cos-distcp-1.12-3.1.0.jar | COSN에 데이터를 복사할 COSDistCp 패키지 | COSDistCp 툴을 참고하십시오 |

chdfs_hadoop_plugin_network-2.8.jar | OFS 플러그인 | |

Hadoop-COS | Version >= 8.1.5 | Hadoop-COS 툴을 참고하십시오 |

cos_api-bundle | 버전은 Hadoop-COS 버전과 일치해야 합니다 |

cosn://bucketname-appid/ 형식의 메타데이터 가속 버킷에 대한 액세스 지원;core-site.xml을 수정하고 구성을 모든 노드에 배포합니다. 데이터만 마이그레이션해야 하는 경우 빅 데이터 컴포넌트를 다시 시작할 필요가 없습니다.key | value | 구성 파일 | 설명 |

fs.cosn.trsf.fs.ofs.impl | com.qcloud.chdfs.fs.CHDFSHadoopFileSystemAdapter | core-site.xml | COSN 구현 클래스, 필수 입력 |

fs.cosn.trsf.fs.AbstractFileSystem.ofs.impl | com.qcloud.chdfs.fs.CHDFSDelegateFSAdapter | core-site.xml | COSN 구현 클래스, 필수 입력 |

fs.cosn.trsf.fs.ofs.tmp.cache.dir | /data/emr/hdfs/tmp/ 형식 | core-site.xml | 임시 디렉터리로 필수 입력 항목입니다. 모든 MRS 노드에 생성됩니다. 충분한 공간과 권한이 있는지 확인해야 합니다. |

fs.cosn.trsf.fs.ofs.user.appid | COS bucket의 appid | core-site.xml | 필수 |

fs.cosn.trsf.fs.ofs.ranger.enable.flag | false | core-site.xml | 필수 입력 항목입니다. 값이 false인지 확인해야 합니다. |

fs.cosn.trsf.fs.ofs.bucket.region | bucket region | core-site.xml | 필수 입력 항목입니다. 유효한 값: eu-frankfurt(프랑크푸르트), ap-chengdu(청두) 및 ap-singapore(싱가포르) |

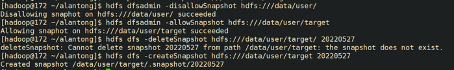

hdfs:///data/user/target을 cosn://{bucketname-appid}/data/user/target으로 마이그레이션해야 한다고 가정합니다.hdfs dfsadmin -disallowSnapshot hdfs:///data/user/hdfs dfsadmin -allowSnapshot hdfs:///data/user/targethdfs dfs -deleteSnapshot hdfs:///data/user/target {현재 날짜}hdfs dfs -createSnapshot hdfs:///data/user/target {현재 날짜}

hadoop fs -libjars /data01/jars/chdfs_hadoop_plugin_network-2.8.jar -mkdir cosn://bucket-appid/distcp-tmp

nohup hadoop jar /data01/jars/cos-distcp-1.10-2.8.5.jar -libjars /data01/jars/chdfs_hadoop_plugin_network-2.8.jar --src=hdfs:///data/user/target/.snapshot/{현재 날짜} --dest=cosn://{bucket-appid}/data/user/target --temp=cosn://bucket-appid/distcp-tmp/ --preserveStatus=ugpt --skipMode=length-checksum --checkMode=length-checksum --cosChecksumType=CRC32C --taskNumber 6 --workerNumber 32 --bandWidth 200 >> ./distcp.log &

CosDistCp CountersBYTES_EXPECTED=10198247BYTES_SKIPPED=10196880FILES_COPIED=1FILES_EXPECTED=7FILES_FAILED=1FILES_SKIPPED=5

통계 항목 | 설명 |

BYTES_EXPECTED | 원본 디렉터리 통계에 따라 복사할 파일의 총 크기, 단위: 바이트 |

FILES_EXPECTED | 원본 디렉터리 통계에 따라 복사할 파일 수. 디렉터리 파일 포함 |

BYTES_SKIPPED | 스킵할 수 있는 파일의 총 크기(바이트)(동일한 길이 또는 체크섬 값) |

FILES_SKIPPED | 스킵할 수 있는 원본 파일 수(동일한 길이 또는 체크섬 값) |

FILES_COPIED | 복사 성공한 원본 파일 수 |

FILES_FAILED | 복사 실패한 원본 파일 수 |

FOLDERS_COPIED | 복사 완료한 디렉터리 수 |

FOLDERS_SKIPPED | 스킵한 디렉터리 수 |

--delete 매개변수를 사용하여 HDFS와 COS 데이터 간의 완전한 일관성을 보장할 수 있습니다.--delete 매개변수를 사용할 때 --deleteOutput=/xxx(사용자 지정) 매개변수를 추가해야 하지만 --diffMode 매개변수는 추가하지 않아야 합니다.nohup hadoop jar /data01/jars/cos-distcp-1.10-2.8.5.jar -libjars /data01/jars/chdfs_hadoop_plugin_network-2.8.jar --src=--src=hdfs:///data/user/target/.snapshot/{현재 날짜} --dest=cosn://{bucket-appid}/data/user/target --temp=cosn://bucket-appid/distcp-tmp/ --preserveStatus=ugpt --skipMode=length-checksum --checkMode=length-checksum --cosChecksumType=CRC32C --taskNumber 6 --workerNumber 32 --bandWidth 200 --delete --deleteOutput=/dele-xx >> ./distcp.log &

trash 디렉터리로 이동되고 이동된 파일 목록은 /xxx/failed 디렉터리에 생성됩니다. hadoop fs -rm URL 또는 hadoop fs -rmr URL을 실행하여 trash 디렉터리의 데이터를 삭제할 수 있습니다.피드백